Yapay Zekanın Gizli Motoru: Türev ve Zincir Kuralı Nedir?

Yapay zeka denildiğinde akla genellikle karmaşık kod satırları veya kendi kendine düşünen robotlar gelir. Ancak işin mutfağına girdiğinizde, bu devasa sistemlerin aslında "değişimi anlama sanatı" üzerine kurulu olduğunu görürsünüz. Bu sanatın adı ise matematikte Türev, uygulayıcısı ise Zincir Kuralı'dır.

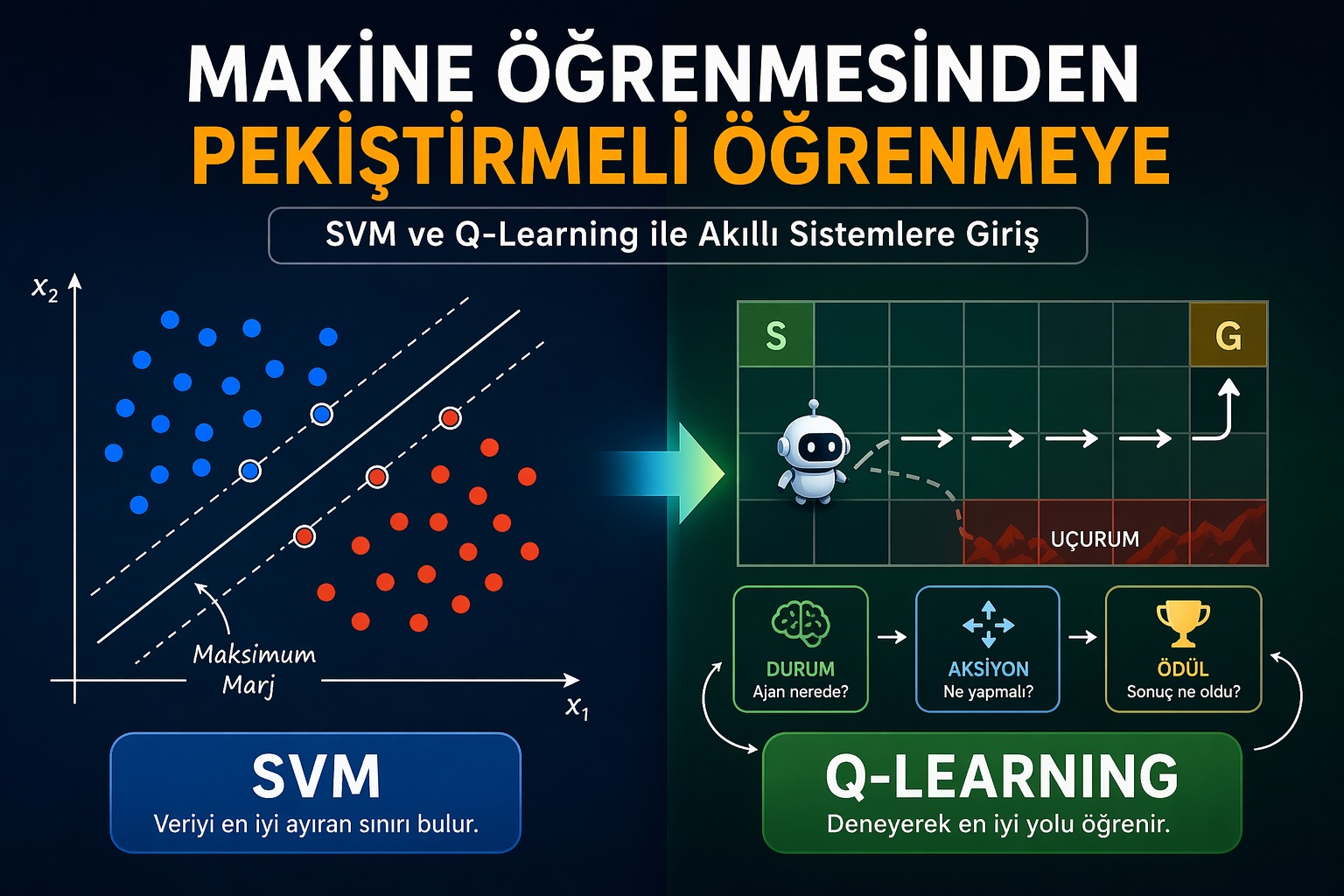

Peki, bir algoritma nasıl olur da bir kediyi bir köpekten ayırmayı "öğrenir"? Cevap, hatasını minimize etmek için kullandığı o muazzam matematiksel araçlarda gizli.

Yapay Zekada Türev Ne İfade Ediyor?

Basitçe söylemek gerekirse türev, yapay zekada bir "yol gösterici" veya "pusula" işlevi görür.

Yapay zeka modelleri, bir görevi yerine getirirken (örneğin bir resmin ne olduğunu tahmin ederken) başlangıçta hata yaparlar. Bu hatayı ölçen fonksiyona Kayıp Fonksiyonu (Loss Function) diyoruz. Algoritmanın amacı bu hatayı sıfıra indirmektir.

- Türev burada devreye girer: Türev, "Eğer ben modeldeki bir parametreyi (ağırlığı) çok azıcık değiştirirsem, toplam hata ne yönde değişir?" sorusuna yanıt verir.

- Eğer türev pozitifse, parametreyi artırmak hatayı artırıyor demektir; o halde parametreyi azaltmalıyız.

- Eğer türev negatifse, parametreyi artırmak hatayı azaltıyor demektir.

Yani türev, algoritmanın hatasını azaltmak için hangi yöne doğru "adım atması" gerektiğini söyler.

Zincir Kuralı: Karmaşıklığı Parçalamak

Yapay sinir ağları, birbirine bağlı milyonlarca küçük işlemden (katmanlardan) oluşur. Bir girdi (örneğin bir piksel) sonuca ulaşana kadar onlarca farklı işlemden geçer. En sondaki hatanın, en baştaki küçük bir parametreden nasıl etkilendiğini nasıl hesaplarız?

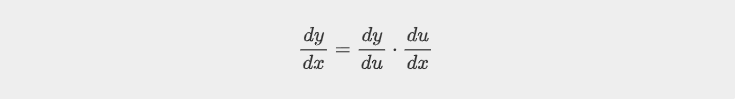

İşte burada Zincir Kuralı (Chain Rule) sahneye çıkar. Matematiksel olarak zincir kuralı, iç içe geçmiş fonksiyonların türevini almamızı sağlar. Eğer y,u'ya bağlıysa ve u da x'e bağlıysa; y'nin x'e göre değişimi şöyledir:

Neden Önemli?

Yapay zekada bu kural, Geri Yayılım (Backpropagation) algoritmasının temelidir. Model, en sondaki hatayı alır ve zincir kuralını kullanarak bu hatayı geriye doğru, her bir katmandaki her bir ağırlığa "paylaştırır".

Örnekle Anlayalım: Ev Fiyatı Tahmin Eden Bir Model

Bir evin fiyatını tahmin eden çok basit bir modelimiz olduğunu düşünelim:

- Girdi (x): Evin metrekaresi.

- Ağırlık (w): Metrekare başına düşen fiyat.

- Tahmin (y): y=w.x.

- Hata (E): Gerçek fiyat ile tahmin arasındaki farkın karesi.

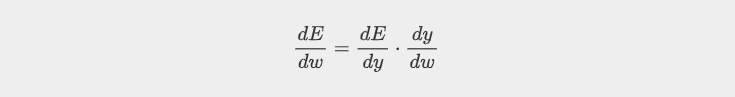

Burada hata (E), tahmine (y) bağlıdır; tahmin (y) ise ağırlığa (w) bağlıdır. Eğer ağırlığımızı (w) güncellemek istiyorsak:

Bu zincirleme işlem sayesinde algoritma, ağırlığı ne yönde değiştireceğini net bir sayı ile hesaplar.

Sonuç: Matematik Olmadan Zeka Olmaz

Yapay zeka, sadece veriden öğrenen bir sistem değil, aslında türev alarak hata yüzeyinde yolunu bulan bir optimizasyon makinesidir. Bir dahaki sefere telefonunuz yüzünüzü tanıdığında, arka planda milyarlarca zincir kuralı işleminin saniyeler içinde çalıştığını hatırlayın.

Kaynakça

- Goodfellow, I., Bengio, Y., & Courville, A. (2016). Deep Learning. MIT Press.

- Rumelhart, D. E., Hinton, G. E., & Williams, R. J. (1986). Learning representations by back-propagating errors. Nature.

- 3Blue1Brown: Neural Networks - Backpropagation Explained (Video).